ChatGPT und trainierte Sprachmodelle

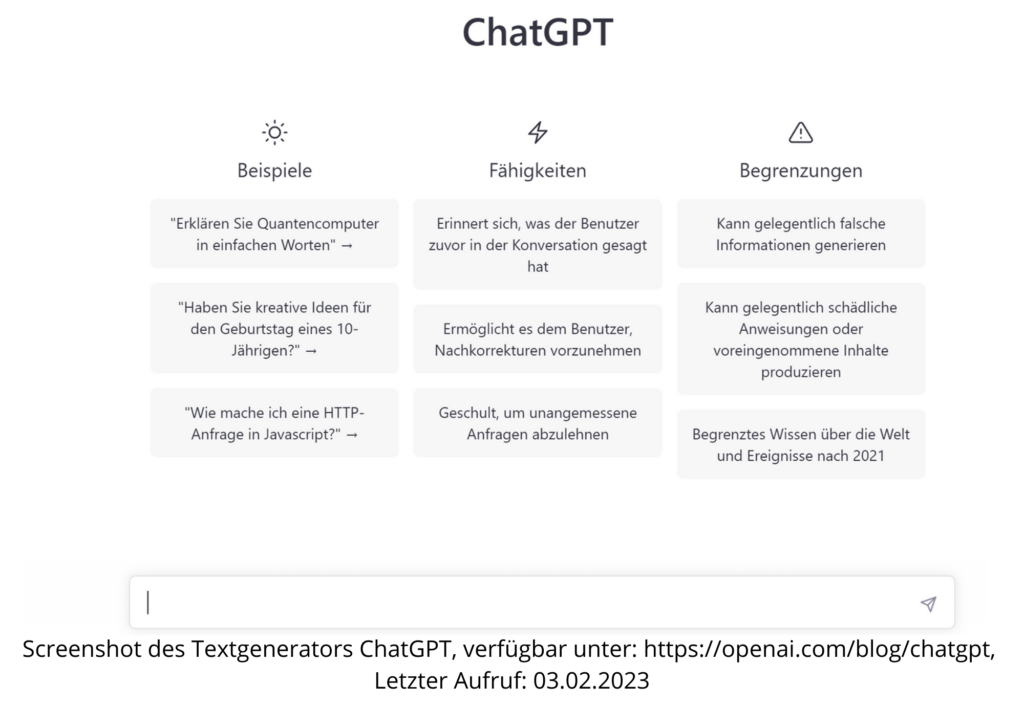

- Textgenerator/ChatBot der Stiftung OpenAI, von Elon Musk und Microsoft finanziert

- derzeit kostenlose Browseranwendung (Betaversion im November 2022 veröffentlicht) unter https://chat.openai.com/

- für einen Account wird Mailadresse und Handynummer benötigt

- nutzbar auf dem PC, Laptop, Tablet, Smartphone

- ChatGPT ist ein Textgenerierungsmodell; GPT steht für „Generative Pre-trained Transformer“

- künstliches neuronales Netz, trainiert in mehreren Sprachen, auf Deep Learning basierendes, vortrainiertes Sprachmodell

- genutztes Sprachmodell zum Zeitpunkt der Veröffentlichung der Betaversion im November 2022 GPT-3, seit Februar 2023 GPT-3,5 oder GPT-4

- Proversion von ChatGPT seit Februar 2023 für 20 $ pro Monat erhältlich, Nachfolgeversion ChatGPT-4 seit 15.3.23 verfügbar (Pro+Warteliste)

- Dialogformat mit Fähigkeit, sich zu verbessern und zu lernen

Trainingsmodelle

Damit mit ChatGPT Fragen beantwortet werden können, muss die KI zuvor mit umfangreichen Trainingsdaten gefüttert werden. Das Sprachmodell, welches hinter ChatGPT steht, war bei der Veröffentlichung der Betaversion GPT-3, mittlerweile liegt bei der Suchmaschine BING oder in der Proversion von ChatGPT das Sprachmodell GPT-4 als Datenbasis im Hintergrund.

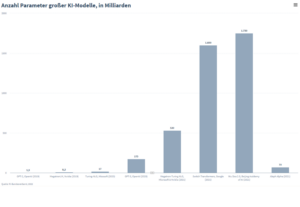

Das Sprachmodell GPT-3 wurde mit 175 Parametern trainiert. Parameter bezeichnet dabei die Anzahl der Datensätze, mit denen das Sprachmodell trainiert wurde. Wie die folgende Statistik zeigt, ist GPT-3 nicht das Sprachmodell mit den meisten Parametern. Das amerikanische und chinesische Sprachmodell stechen weit hervor.

Aleph Alpha wurde mit 70 Parametern trainiert. Bedeutsam dabei ist, dass es sich dabei um ein deutsches Sprachmodell handelt.

Hintergrund für die Vormachtstellung von China und Amerika bei der Entwicklung der Sprachmodelle ist unter anderem, dass für das Training eine sehr hohe Rechenpower und ein hohes Budget erforderlich ist und kleine und mittlere Unternehmen dieses nicht stemmen können. „Tom Goldstein ist Professor für künstliche Intelligenz und maschinelles Lernen an der Maryland Universität (USA) und schätzt die täglichen Kosten von ChatGPT auf 100.000 US-Dollar pro Tag.“ (https://finantio.de/wissen/chatgpt-statistiken).

Das Sprachmodell GPT-4 wurde bereits mit einer Trillion Parametern trainiert, welches die gleiche Anzahl von Parametern darstellt wie Neuronen im menschlichen Gehirn. Möglich war dies auch durch den großen Durchbruch von ChatGPT und die hohen Nutzer*innenzahlen von 1 Millionen direkt nach 5 Tagen. Derzeit gibt es keine offiziellen Nutzer*innenzahlen, geschätzt wird über 100 Millionen (https://finantio.de/wissen/chatgpt-statistiken).